LLM Evaluation Jobs는 CoreWeave에서 관리하는 인프라를 사용해 LLM 모델의 성능을 벤치마킹하는 프레임워크입니다. 최신 업계 표준을 폭넓게 아우르는 모델 평가 벤치마크 세트 중에서 선택한 뒤, W&B Models의 자동 리더보드와 차트를 통해 결과를 조회·분석·공유할 수 있습니다. LLM Evaluation Jobs를 사용하면 직접 GPU 인프라를 구축하고 유지 관리해야 하는 복잡성을 제거할 수 있습니다.Documentation Index

Fetch the complete documentation index at: https://translations.mintlify.app/llms.txt

Use this file to discover all available pages before exploring further.

LLM Evaluation Jobs는 W&B 멀티 테넌트 클라우드에서 현재 미리보기(Preview) 단계입니다. 미리보기 기간 동안에는 컴퓨트 리소스를 무료로 사용할 수 있습니다. 자세히 알아보기

작동 방식

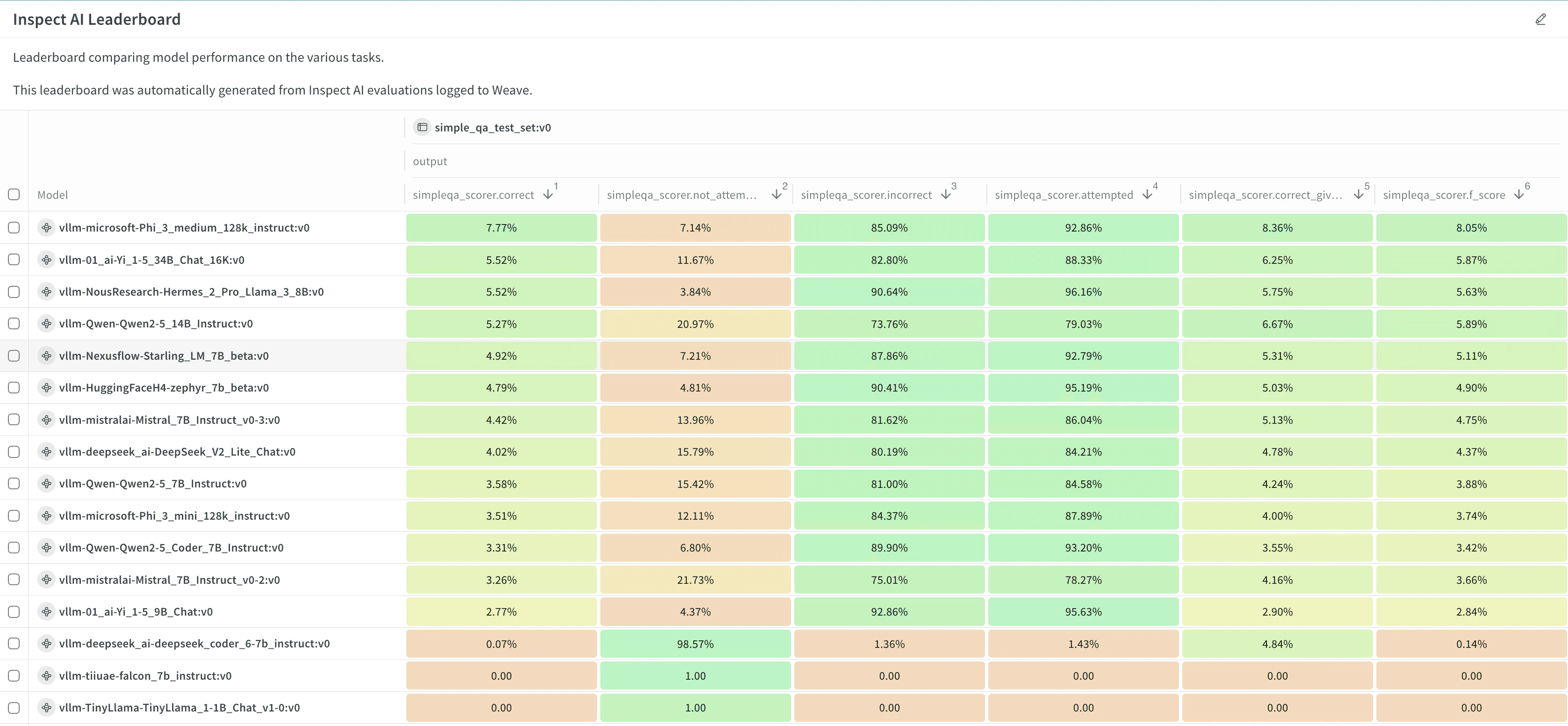

- W&B Models에서 평가 작업을 설정합니다. 리더보드 생성 여부 등의 벤치마크와 구성을 정의합니다.

- 평가 작업을 실행합니다.

- 결과와 리더보드를 확인하고 분석합니다.

다음 단계

- 평가 벤치마크 카탈로그를 살펴보세요

- 모델 체크포인트를 평가하세요

- API로 호스팅된 모델을 평가하세요

자세한 내용

가격

작업 제한

- 컨텍스트를 포함해 평가할 수 있는 모델의 최대 크기는 86 GB입니다.

- 각 작업은 최대 2개의 GPU만 사용할 수 있습니다.

요구 사항

- 모델 체크포인트를 평가하려면 모델 가중치가 VLLM과 호환되는 아티팩트로 패키징되어 있어야 합니다. 자세한 내용과 예제 코드는 예시: 모델 준비하기를 참고하세요.

- OpenAI 호환 모델을 평가하려면, 해당 모델이 공개 URL을 통해 접근 가능해야 하며, 조직 또는 팀 관리자(admin)가 인증용 API key를 포함한 팀 시크릿을 설정해야 합니다.

- 일부 벤치마크는 점수 계산에 OpenAI 모델을 사용합니다. 이러한 벤치마크를 실행하려면, 조직 또는 팀 관리자(admin)가 필요한 API key를 포함한 팀 시크릿을 설정해야 합니다. 특정 벤치마크에 이 요구 사항이 있는지 확인하려면 Evaluation benchmark catalog를 참고하세요.

- 일부 벤치마크는 Hugging Face의 게이트된 데이터셋에 대한 액세스가 필요합니다. 이러한 벤치마크를 실행하려면, 조직 또는 팀 관리자(admin)가 Hugging Face에서 해당 게이트된 데이터셋에 대한 액세스를 요청하고, Hugging Face 사용자 액세스 토큰을 생성한 다음 이를 팀 시크릿으로 설정해야 합니다. 특정 벤치마크에 이 요구 사항이 있는지 확인하려면 Evaluation benchmark catalog를 참고하세요.