Colab에서 실행해 보기 W&B OpenAI API 통합을 사용하여 모든 OpenAI 모델(파인튜닝된 모델 포함)에 대한 요청, 응답, 토큰 수, 모델 메타데이터를 로깅하세요.Documentation Index

Fetch the complete documentation index at: https://translations.mintlify.app/llms.txt

Use this file to discover all available pages before exploring further.

W&B로 파인튜닝 실험, 모델, 데이터셋을 추적하고 동료와 결과를 공유하는 방법은 OpenAI 파인튜닝 통합을 참고하세요.

OpenAI Python API 라이브러리 설치

OpenAI Python API를 사용하기

1. autolog을 임포트하고 초기화하기

wandb.integration.openai에서 autolog를 임포트하고 초기화합니다.

wandb.init()이 받는 인수를 딕셔너리로 묶어 선택적으로 autolog에 전달할 수 있습니다. 여기에는 프로젝트 이름, 팀 이름, 엔터티 등 다양한 설정이 포함됩니다. wandb.init()에 대한 자세한 내용은 API Reference Guide를 참조하세요.

2. OpenAI API 호출

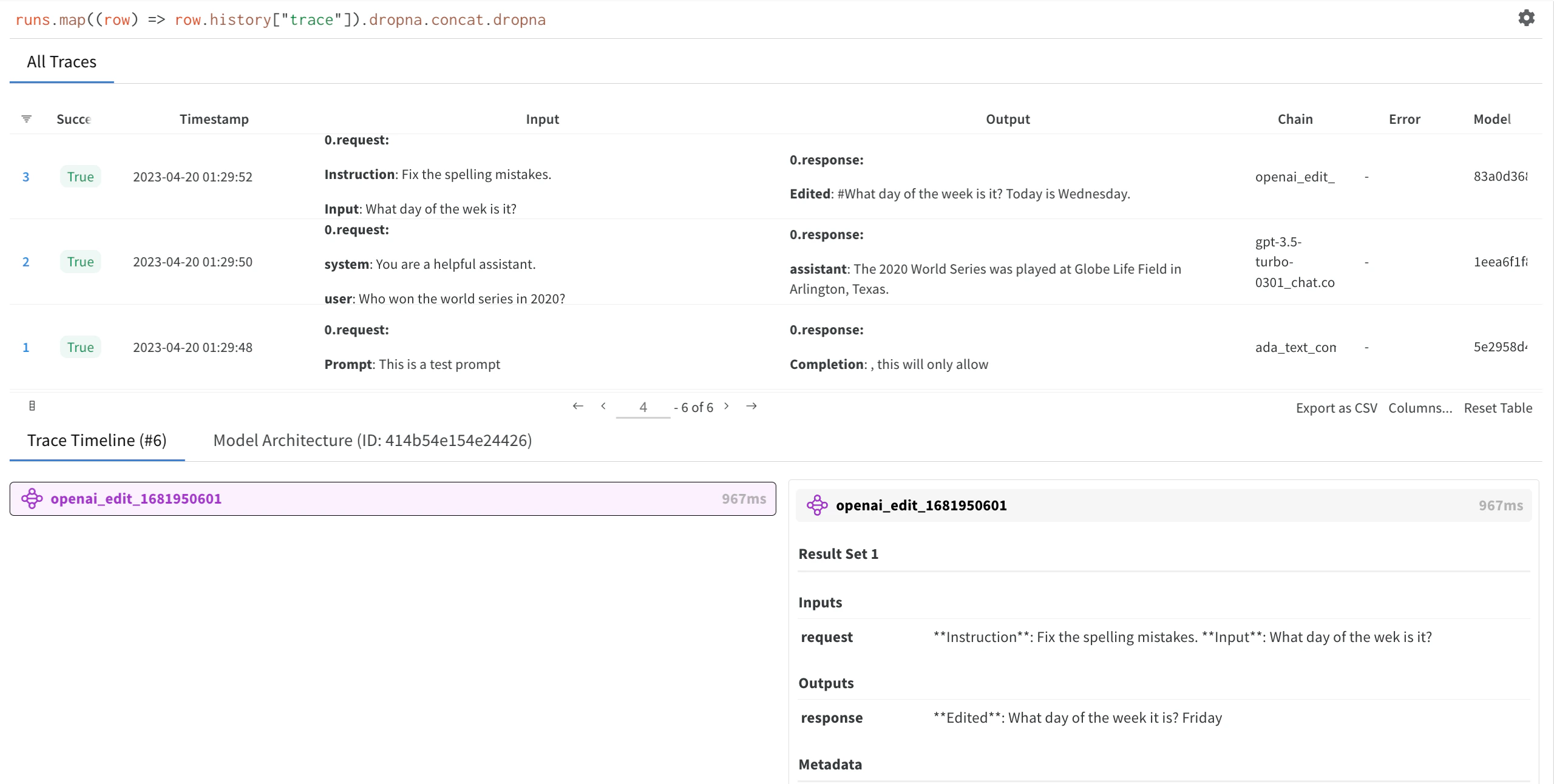

3. OpenAI API 입력과 응답 확인하기

autolog에 의해 생성된 W&B run 링크를 클릭합니다. 그러면 W&B App의 프로젝트 워크스페이스로 이동합니다.

OpenAI LLM에 사용된 trace 테이블, trace 타임라인, 그리고 모델 아키텍처를 확인하려면 생성한 실행 중 하나를 선택합니다.

autolog 비활성화

disable()을 호출할 것을 W&B가 권장합니다.