LLM 프롬프트와 응답을 평가하는 일은 어렵습니다. Weave Playground는 LLM 프롬프트와 응답을 반복적으로 개선하는 과정을 단순화하여 다양한 모델과 프롬프트를 더 쉽게 실험할 수 있도록 설계되었습니다. 프롬프트 편집, 메시지 재시도, 모델 비교와 같은 기능을 통해 Playground는 LLM 애플리케이션을 빠르게 테스트하고 개선하는 데 도움을 줍니다. 현재 Playground는 OpenAI, Anthropic, Google과 같은 프로바이더의 모델과 사용자 정의 프로바이더를 지원합니다.Documentation Index

Fetch the complete documentation index at: https://translations.mintlify.app/llms.txt

Use this file to discover all available pages before exploring further.

- 빠른 접근: 새 세션을 시작하려면 Weave 사이드바 메뉴에서 ‘Playground’를 열거나, 기존 프로젝트를 테스트하려면 Call 페이지에서 엽니다.

- 메시지 제어: 채팅 내에서 메시지를 직접 편집, 재시도 또는 삭제합니다.

- 유연한 메시징: 새 메시지를 사용자 또는 시스템 입력으로 추가하고 LLM에 전송합니다.

- 사용자 정의 가능한 설정: 선호하는 LLM 프로바이더를 설정하고 모델 설정을 조정합니다.

- 여러 LLM 지원: 팀 수준 API key 관리를 통해 모델 간을 전환합니다.

- 모델 비교: 서로 다른 모델이 프롬프트에 어떻게 응답하는지 비교합니다.

- 사용자 정의 프로바이더: 사용자 정의 모델에 대해 OpenAI 호환 API 엔드포인트를 테스트합니다.

- 저장된 모델: 워크플로에 재사용할 수 있는 모델 프리셋을 생성하고 구성합니다.

공급자 자격 증명 및 정보 추가

- Amazon Bedrock:

AWS_ACCESS_KEY_IDAWS_SECRET_ACCESS_KEYAWS_REGION_NAME

- Anthropic:

ANTHROPIC_API_KEY - Azure:

AZURE_API_KEYAZURE_API_BASEAZURE_API_VERSION

- Deepseek:

DEEPSEEK_API_KEY - Google:

GEMINI_API_KEY - Groq:

GROQ_API_KEY - Mistral:

MISTRAL_API_KEY - OpenAI:

OPENAI_API_KEY - X.AI:

XAI_API_KEY

Playground에 접근하기

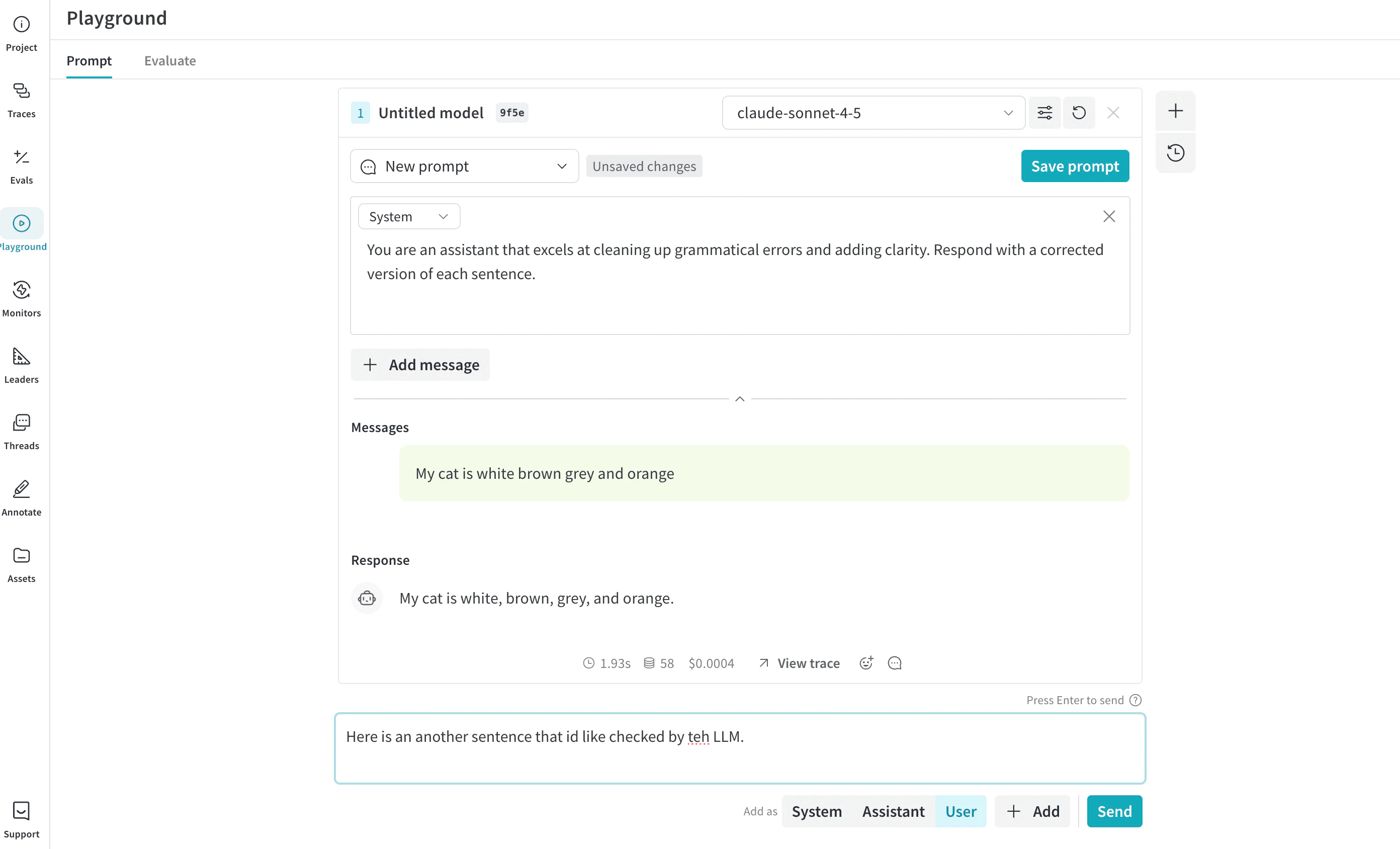

- 간단한 system 프롬프트로 새 Playground 페이지 열기: Weave 프로젝트의 사이드바에서 Playground를 선택합니다. Playground가 같은 탭에서 열립니다.

- 특정 호출에 대한 Playground 열기:

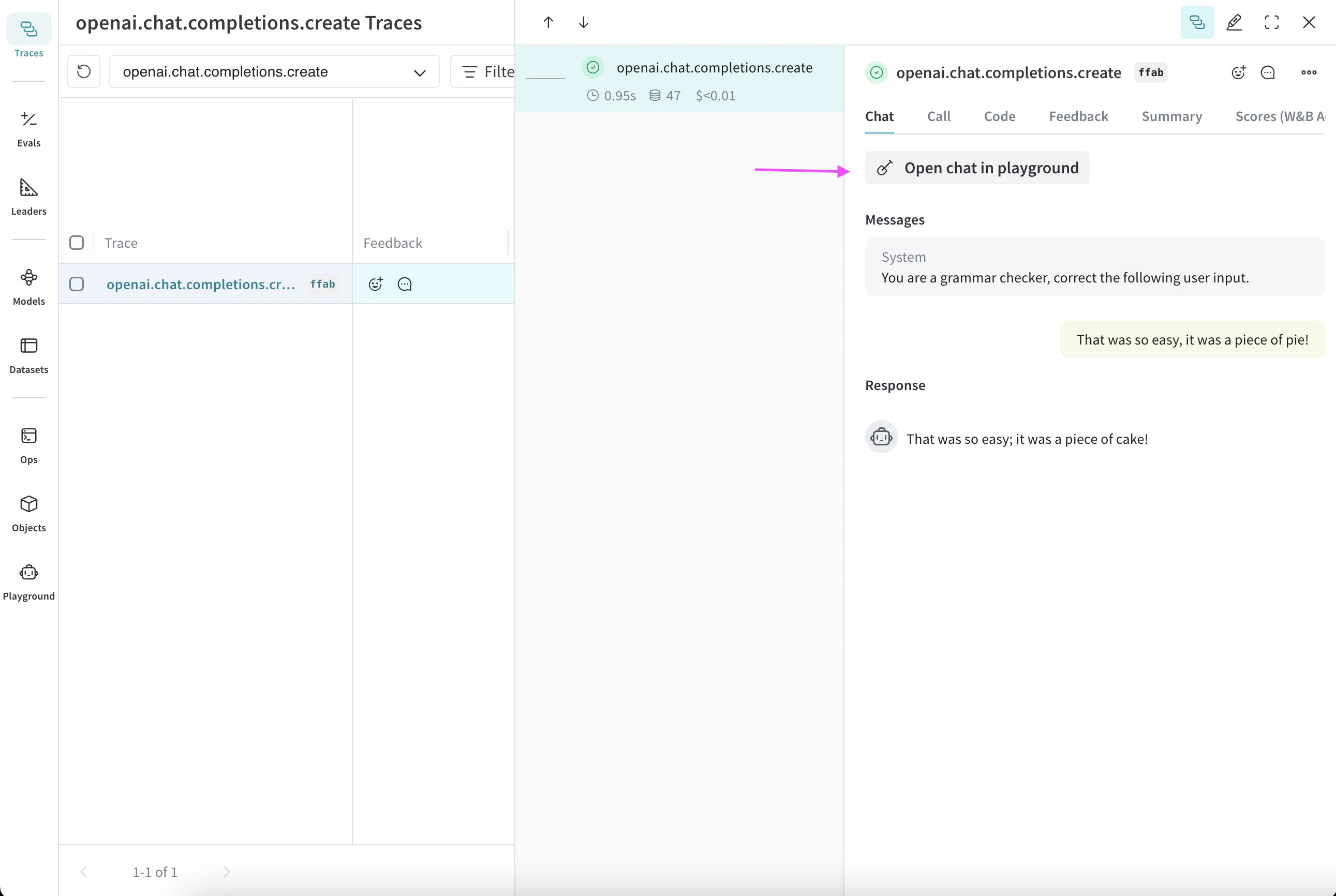

- 사이드바에서 Traces 탭을 선택합니다. 트레이스 목록이 표시됩니다.

- 트레이스 목록에서 확인하려는 호출의 이름을 클릭합니다. 호출의 세부 정보 페이지가 열립니다.

- Open chat in Playground를 클릭합니다. Playground가 새 탭에서 열립니다.

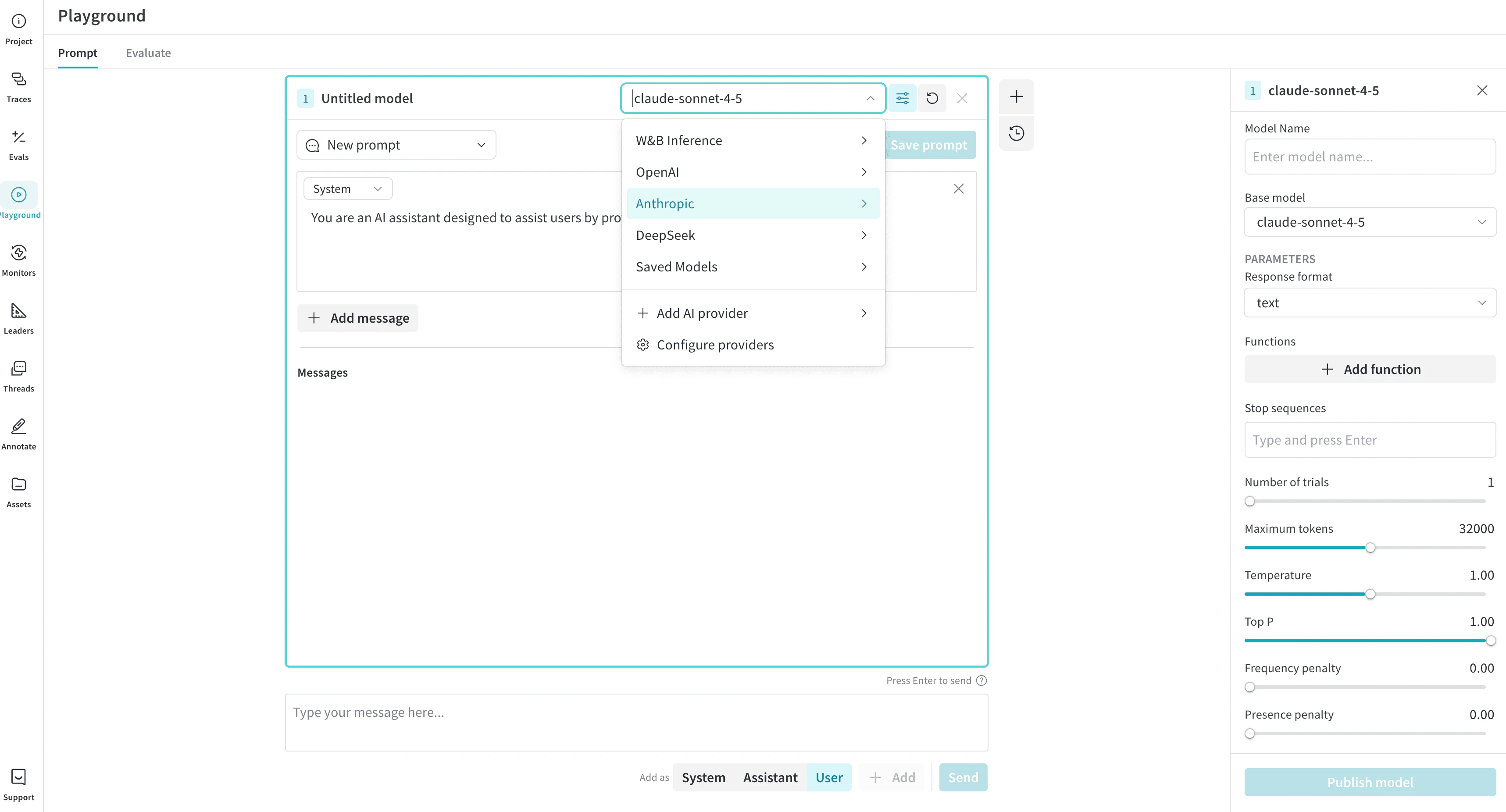

LLM 선택

- Amazon Bedrock

- Anthropic

- Azure

- Deepseek

- Groq

- Mistral

- OpenAI

- X.AI

Playground 설정 사용자 정의하기

LLM 파라미터 조정

- 프롬프트 헤더(메인 패널 상단)에서 Chat settings () 버튼을 클릭해 Chat settings 패널을 엽니다.

- Chat settings 패널에서 원하는 대로 파라미터를 조정합니다. Weave 호출 추적을 켜거나 끌 수 있고, 함수를 추가할 수도 있습니다.

- 변경 사항은 자동으로 적용됩니다. 패널을 닫으려면 Chat settings를 다시 클릭하거나, 오른쪽 위의 x를 클릭하세요. Chat settings 버튼에 마우스를 올렸을 때 표시되는 툴팁 텍스트는 변경한 설정을 반영해 업데이트됩니다.

1입니다. 시도 횟수를 조정하려면 Chat settings 패널을 열고 Number of trials 설정을 변경하세요.

함수 추가하기

메시지 제어

프롬프트 정의 영역

- 프롬프트 선택기: 저장된 프롬프트를 선택하거나 새로 만듭니다.

- 메시지 역할 선택기: 정의할 메시지의 역할(System, Assistant, 또는 User 역할)을 지정합니다.

- 프롬프트 텍스트: 모델이 어떻게 응답해야 하는지 규정하는 지시 텍스트를 입력합니다.

- Add message 버튼: 실행 전에 프롬프트 컨텍스트에 추가 메시지를 포함할 수 있습니다.

- 추가적인 시스템 수준 지시를 전달합니다.

- 응답을 유도하기 위한 어시스턴트 메시지 예제를 제공합니다(예: few-shot 프롬픗팅).

- 특정 시나리오를 테스트하기 위해 사용자 메시지를 미리 정의합니다.

Messages 패널

- 프롬프트 설정에 포함된 사전 정의 메시지

- 메시지 작성기에서 보낸 메시지

- 모델이 반환한 응답

메시지 컴포저(입력 필드)

메시지 기록 보기

LLM 비교

커스텀 프로바이더

사용자 지정 provider 추가하기

- 지원되는 모델 provider의 이전 버전

- 로컬 모델

- 프롬프트 헤더(메인 패널 상단)에서 Select a model 드롭다운을 클릭합니다.

- + Add AI provider를 선택합니다.

- Custom Provider를 선택합니다.

- 팝업 모달에서 provider 정보를 입력합니다:

- Provider name:

openai또는ollama와 같은 provider 이름. - API key: OpenAI API key와 같은 provider의 API key.

- Base URL:

https://api.openai.com/v1/또는https://e452-2600-1700-45f0-3e10-2d3f-796b-d6f2-8ba7.ngrok-free.app같은 ngrok URL 등 provider의 기본 엔드포인트. - Headers: (옵션) 하나 이상의 커스텀 HTTP 헤더 키-값 쌍.

- Models:

deepseek-r1또는qwq와 같은 provider용 하나 이상의 모델. - Max tokens: (옵션) 각 모델이 응답에서 생성할 수 있는 최대 토큰 수.

- provider 정보를 모두 입력했으면 Add provider를 클릭합니다.

- Select a model 드롭다운에서 새 provider와 사용 가능한 모델을 선택합니다.

커스텀 프로바이더 편집

- 프롬프트 헤더에서 Select a model 드롭다운을 클릭한 다음 +Configure providers를 선택합니다.

- 또는 사이드바 메뉴에서 Project를 선택한 후 AI Providers 탭을 선택합니다.

- Custom providers 테이블에서 업데이트하려는 커스텀 프로바이더를 찾습니다.

- 해당 커스텀 프로바이더 항목의 Last Updated 열에서 편집 버튼(연필 아이콘)을 클릭합니다.

- 표시되는 모달 창에서 프로바이더 정보를 편집합니다.

- Save를 클릭합니다.

사용자 지정 프로바이더 제거

- 프롬프트 헤더에서 Select a model 드롭다운을 클릭한 다음 +Configure providers를 선택합니다.

- 또는 사이드바 메뉴에서 Project를 선택한 다음 AI Providers 탭을 선택할 수도 있습니다.

- Custom providers 테이블에서 삭제하려는 사용자 지정 프로바이더를 찾습니다.

- 해당 사용자 지정 프로바이더 항목의 Last Updated 열에서 삭제 버튼(휴지통 아이콘)을 클릭합니다.

- 팝업 모달에서 프로바이더를 삭제할 것인지 확인합니다. 이 작업은 되돌릴 수 없습니다.

- Delete를 클릭합니다.

로컬 모델을 커스텀 provider로 사용하기

- 사용하는 운영체제에 맞게 ngrok을 설치합니다.

-

Ollama 모델을 시작합니다:

-

다른 터미널에서 필요한 CORS 헤더와 함께 ngrok 터널을 생성합니다:

-

ngrok이 시작되면

https://xxxx-xxxx.ngrok-free.app와 같은 공용 URL이 표시됩니다. Playground에서 커스텀 provider를 추가할 때 이 URL을 Base URL로 사용하세요.

저장된 모델

모델 저장

- 프롬프트 헤더(메인 패널 상단)의 Select a model 드롭다운에서 모델 제공자와 모델을 선택합니다.

- 프롬프트 헤더에서 Chat settings () 버튼을 클릭하여 Chat settings 패널을 엽니다.

- Chat settings 패널에서:

- Model Name(필수): 저장할 모델의 이름을 입력합니다.

- 필요에 따라 파라미터를 조정합니다. Weave 호출 추적을 켜거나 끌 수 있고, 함수를 추가할 수도 있습니다.

- Publish model을 클릭합니다. 그러면 모델이 저장되며, Select a model 드롭다운의 Saved Models에서 선택할 수 있습니다. 이제 저장된 모델을 사용하고 업데이트할 수 있습니다.

저장된 모델 사용하기

- 프롬프트 헤더에서 Select a model 드롭다운에서 Saved Models를 선택합니다.

- 저장된 모델 목록에서 불러오려는 저장된 모델을 선택합니다. 모델이 로드되며 Playground에서 바로 사용할 수 있습니다.

저장된 모델 업데이트

- 프롬프트 헤더의 Select a model 드롭다운에서 Saved Models를 선택합니다.

- 저장된 모델 목록에서 업데이트하려는 저장된 모델을 선택합니다.

- 프롬프트 헤더에서 Chat settings () 버튼을 클릭하여 Chat settings 패널을 엽니다.

- Chat settings 패널에서 원하는 대로 매개변수를 조정합니다. Weave 호출 추적을 켜거나 끌 수 있으며, 함수를 추가할 수도 있습니다.

- Update model을 클릭합니다. 모델이 업데이트되며, Select a model 드롭다운의 Saved Models에서 다시 사용할 수 있습니다. 저장된 모델의 버전은 자동으로 증가합니다.