wandb를 사용하면 몇 줄의 코드만으로 scikit-learn 모델의 성능을 시각화하고 서로 비교할 수 있습니다. 예제 실행해 보기 →Documentation Index

Fetch the complete documentation index at: https://translations.mintlify.app/llms.txt

Use this file to discover all available pages before exploring further.

시작하기

회원 가입 및 API key 생성

보다 간편하게 설정하려면 User Settings로 바로 이동해 API key를 생성하세요. 새로 생성된 API key는 즉시 복사하여 비밀번호 관리자와 같은 안전한 위치에 저장하세요.

- 오른쪽 상단에서 사용자 프로필 아이콘을 클릭합니다.

- User Settings를 선택한 다음, 아래로 스크롤하여 API Keys 섹션으로 이동합니다.

wandb 라이브러리를 설치하고 로그인하기

wandb 라이브러리를 설치하고 로그인하려면:

- Command Line

- Python

- Python notebook

-

WANDB_API_KEY환경 변수를 API key로 설정합니다. -

wandb라이브러리를 설치하고 로그인합니다.

메트릭 로깅

플롯 생성하기

1단계: wandb를 임포트하고 새 실행을 초기화하기

2단계: 플롯 시각화하기

개별 플롯

모든 플롯

plot_classifier 같은 함수들이 있습니다:

기존 Matplotlib 플롯

plotly를 설치해야 합니다.

지원되는 플롯 유형

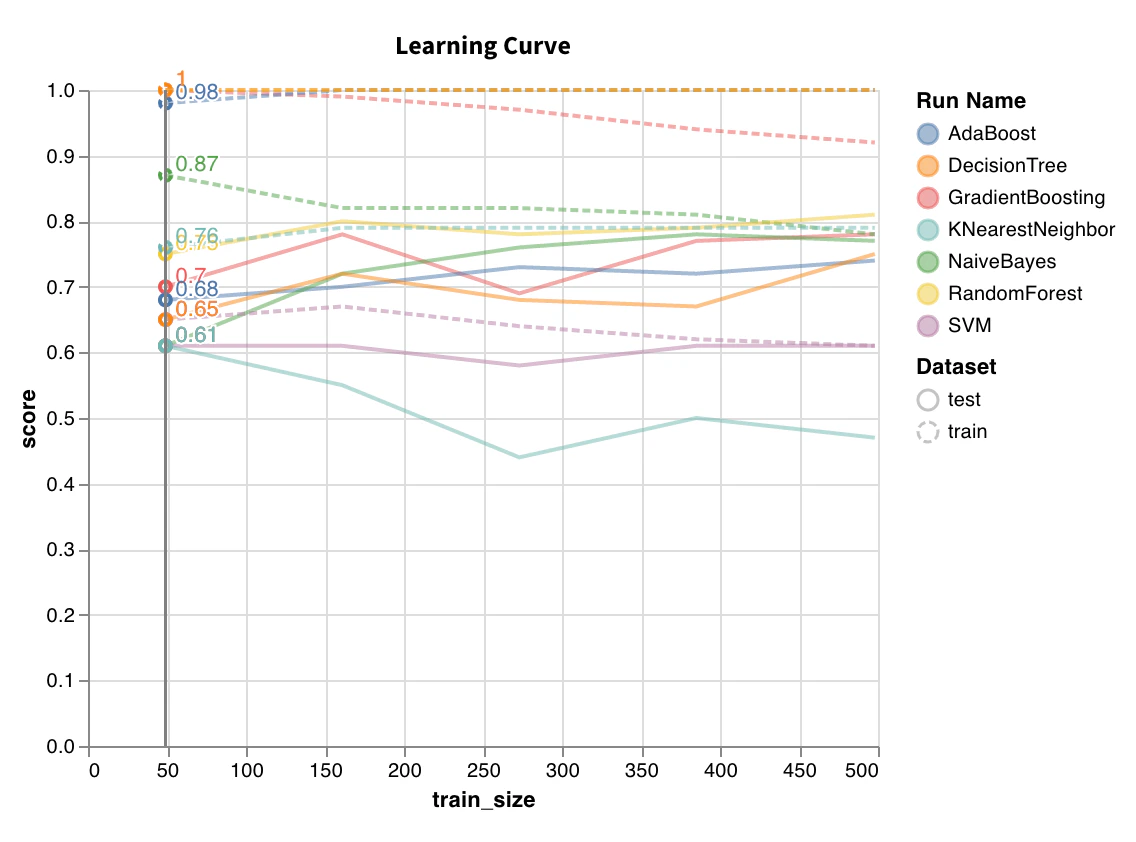

학습 곡선

wandb.sklearn.plot_learning_curve(model, X, y)

- model (clf 또는 reg): 적합이 완료된 회귀 모델(regressor) 또는 분류기(classifier)를 입력으로 받습니다.

- X (arr): 데이터셋 특징(features).

- y (arr): 데이터셋 레이블(labels).

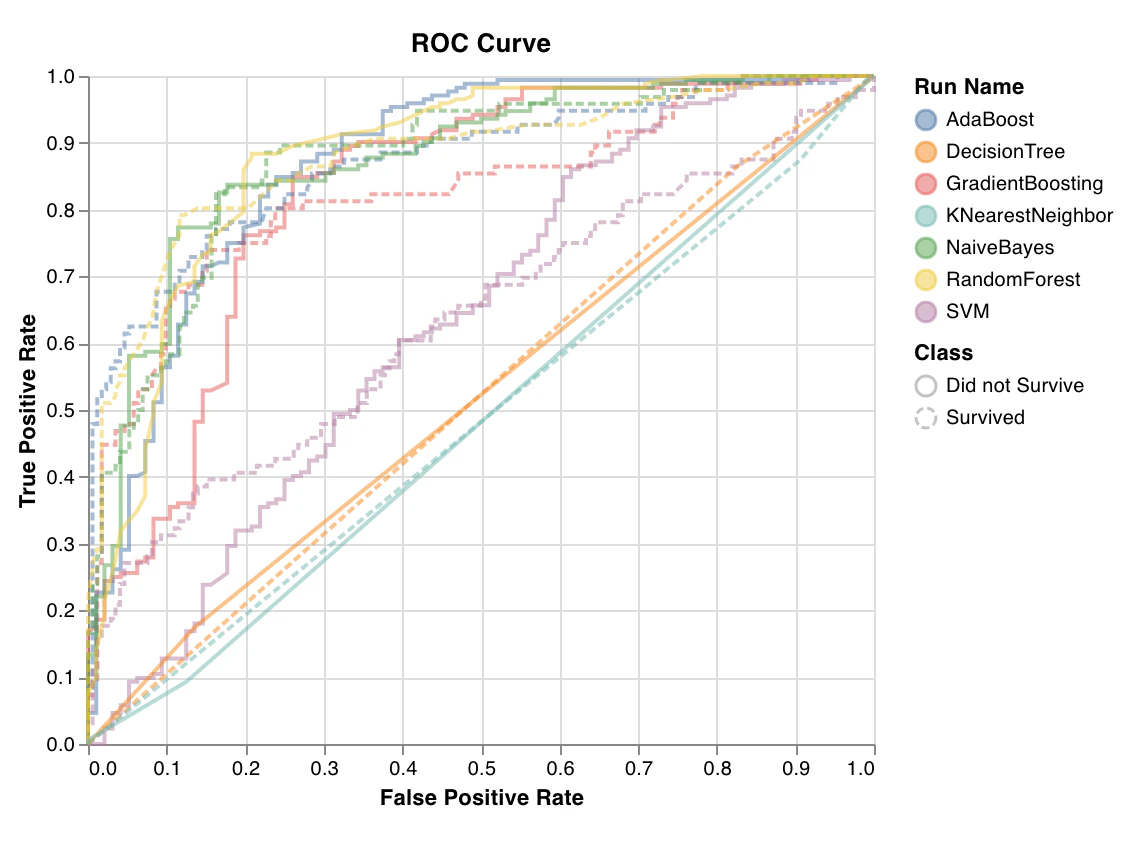

ROC

wandb.sklearn.plot_roc(y_true, y_probas, labels)

- y_true (arr): 테스트 세트의 레이블.

- y_probas (arr): 테스트 세트에 대한 예측 확률.

- labels (list): 타깃 변수(y)의 명명된 레이블.

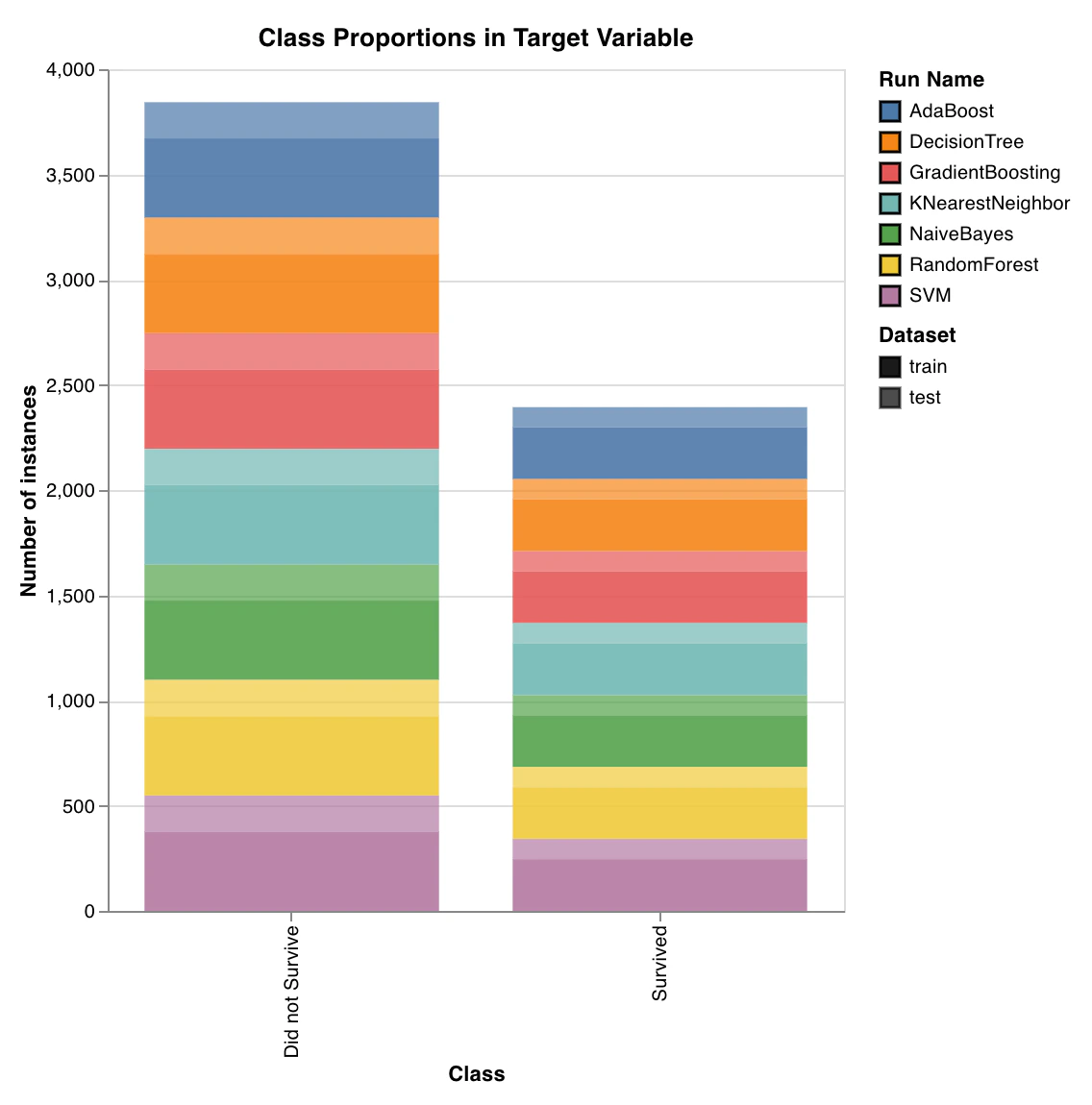

클래스 비율

wandb.sklearn.plot_class_proportions(y_train, y_test, ['dog', 'cat', 'owl'])

- y_train (arr): 학습 세트 레이블.

- y_test (arr): 테스트 세트 레이블.

- labels (list): 타깃 변수(y)의 이름이 지정된 레이블.

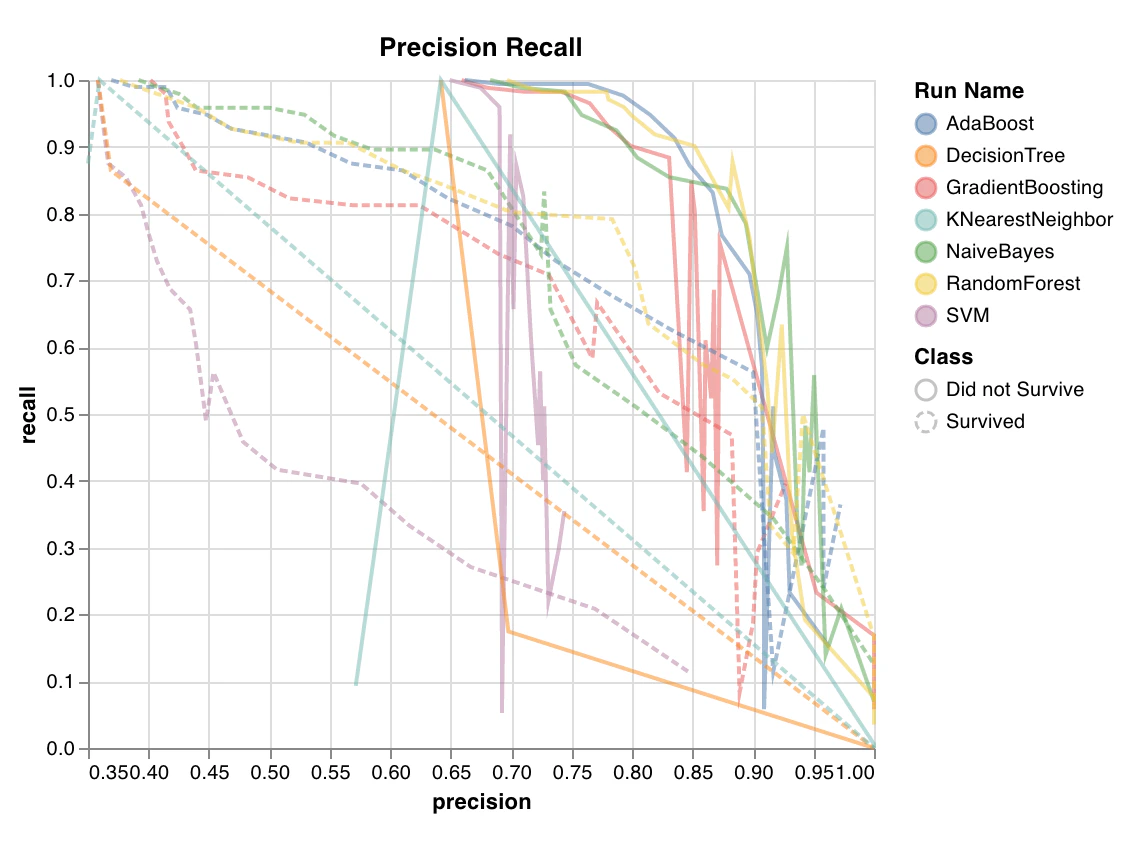

정밀도-재현율 곡선

wandb.sklearn.plot_precision_recall(y_true, y_probas, labels)

- y_true (arr): 테스트 세트 레이블.

- y_probas (arr): 테스트 세트 예측 확률.

- labels (list): 타깃 변수(y)에 대한 이름이 지정된 레이블.

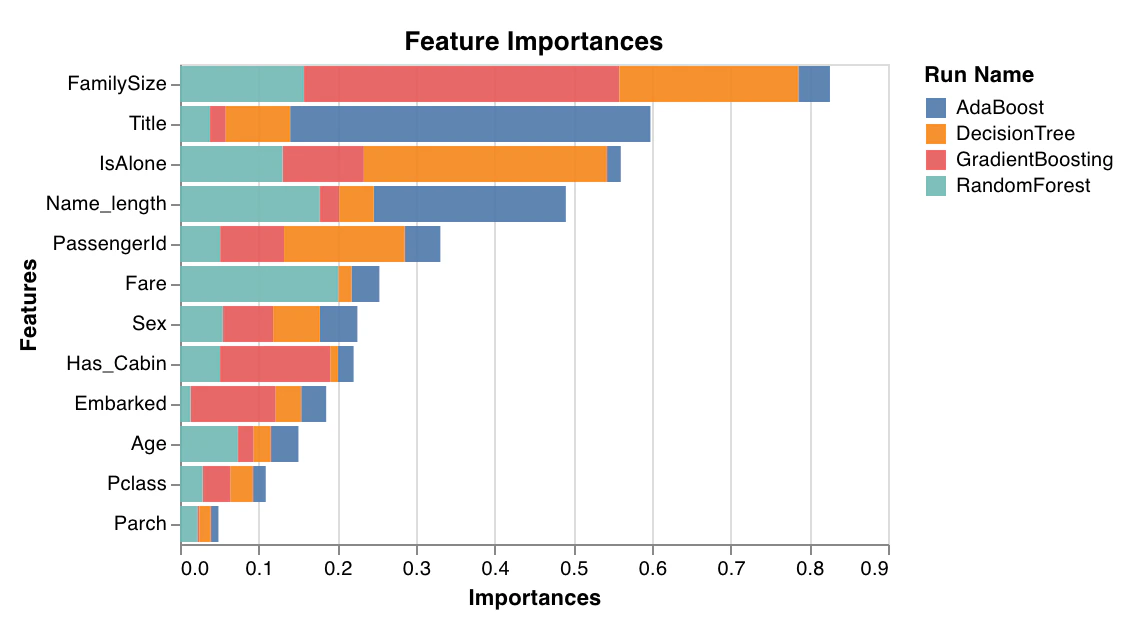

특성 중요도

feature_importances_ 속성이 있는 분류기에서만 작동합니다.

wandb.sklearn.plot_feature_importances(model, ['width', 'height, 'length'])

- model (clf): 학습이 완료된 분류기 모델을 입력합니다.

- feature_names (list): 특성 이름입니다. 특성 인덱스를 해당 이름으로 대체하여 플롯을 더 읽기 쉽게 만듭니다.

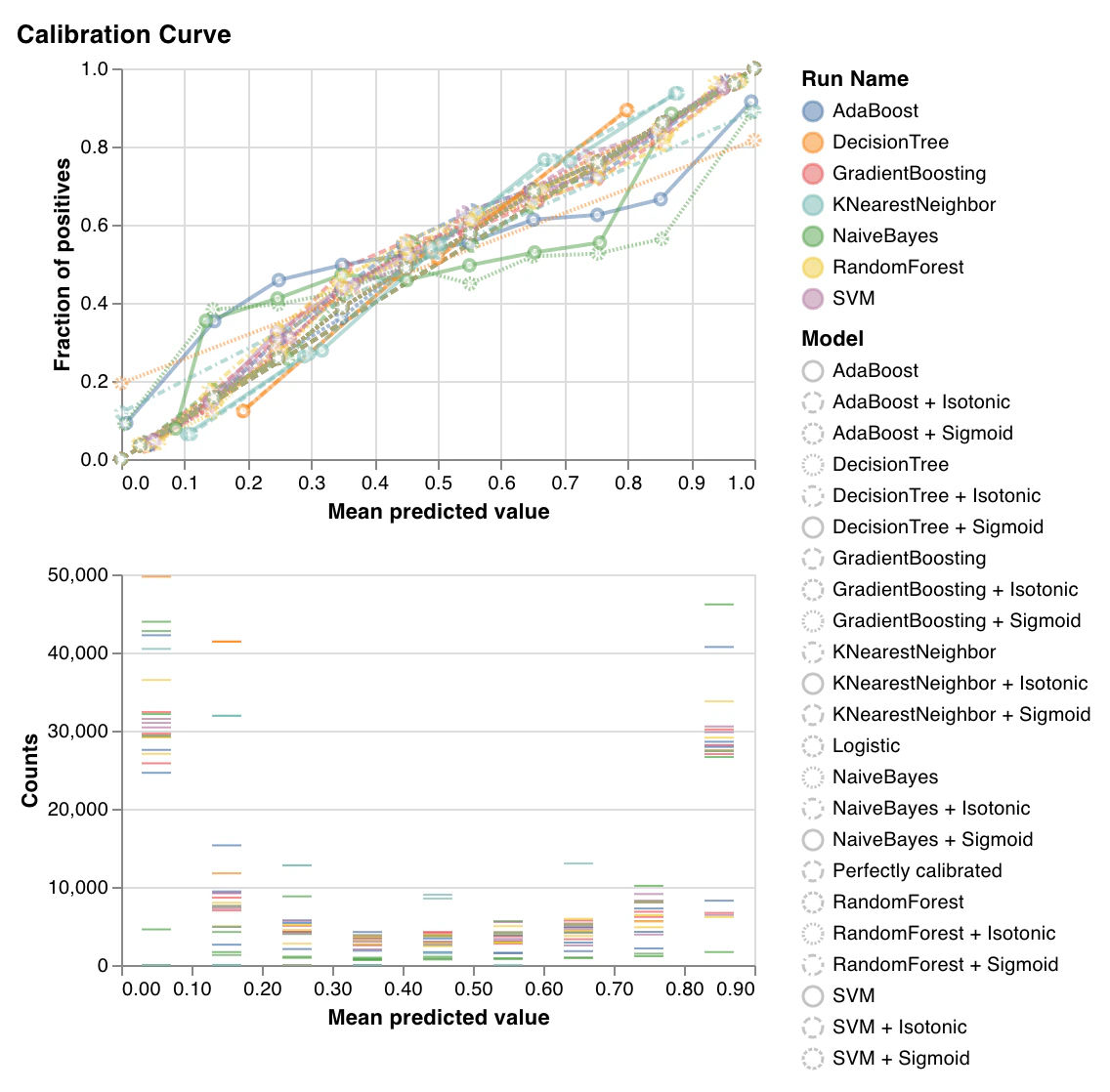

보정 곡선(Calibration curve)

wandb.sklearn.plot_calibration_curve(clf, X, y, 'RandomForestClassifier')

- model (clf): 학습이 완료된 분류기를 전달합니다.

- X (arr): 학습 세트 특성(features)입니다.

- y (arr): 학습 세트 레이블(labels)입니다.

- model_name (str): 모델 이름입니다. 기본값은 ‘Classifier’입니다.

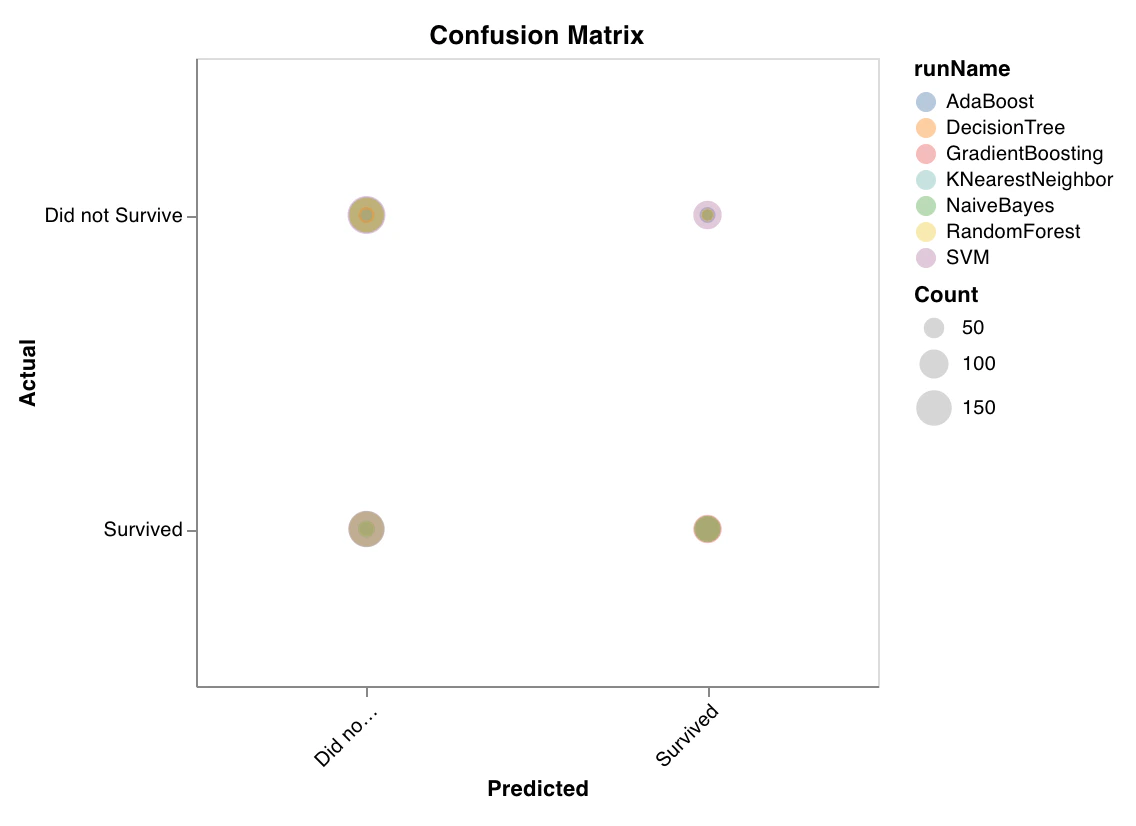

혼동 행렬

wandb.sklearn.plot_confusion_matrix(y_true, y_pred, labels)

- y_true (arr): 테스트 세트의 실제 레이블.

- y_pred (arr): 테스트 세트의 예측 레이블.

- labels (list): 타깃 변수(y)의 레이블 이름 목록.

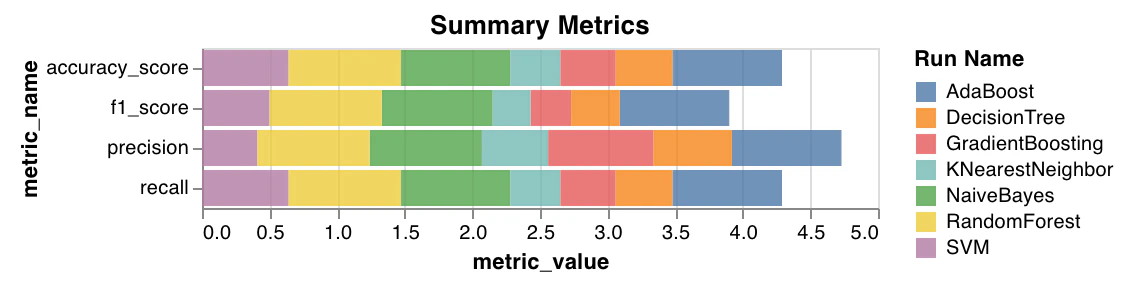

요약 지표

f1,accuracy,precision,recall과 같은 분류용 요약 지표를 계산합니다.mse,mae,r2점수와 같은 회귀용 요약 지표를 계산합니다.

wandb.sklearn.plot_summary_metrics(model, X_train, y_train, X_test, y_test)

- model (clf 또는 reg): 학습이 완료된 회귀기(regressor) 또는 분류기(classifier)를 입력으로 받습니다.

- X (arr): 학습 세트 특성(features).

- y (arr): 학습 세트 레이블(labels).

- X_test (arr): 테스트 세트 특성(features).

- y_test (arr): 테스트 세트 레이블(labels).

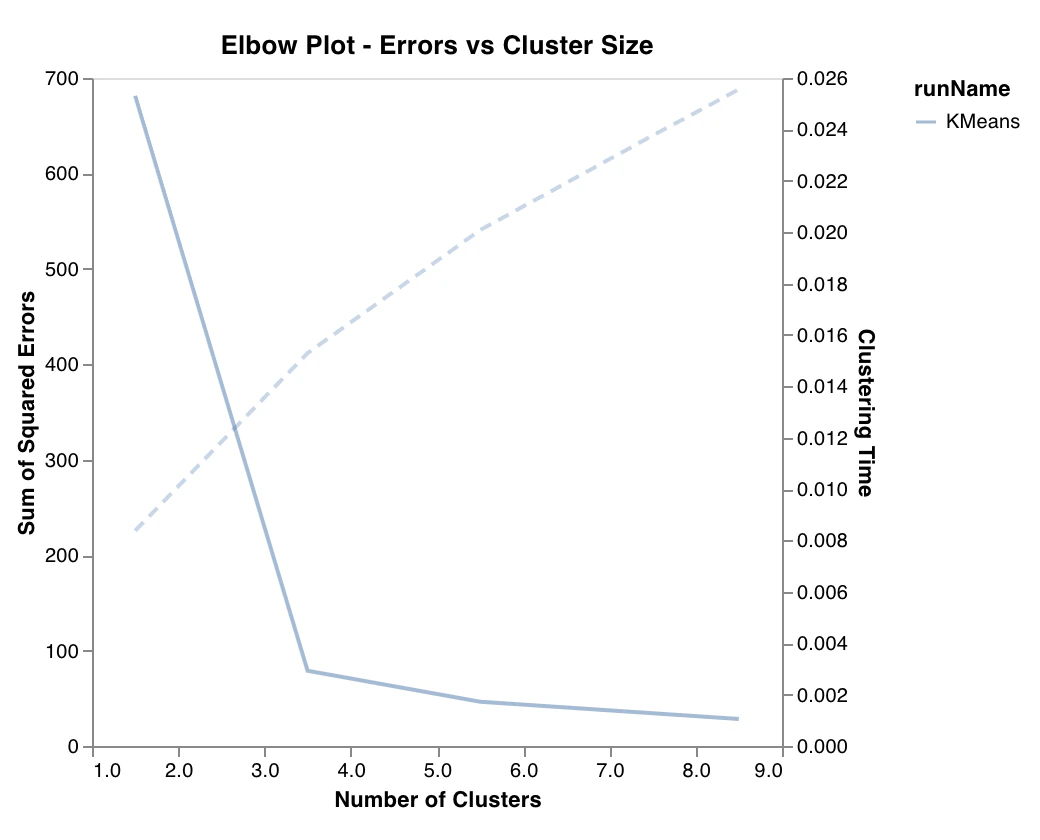

엘보 플롯

wandb.sklearn.plot_elbow_curve(model, X_train)

- model (clusterer): 학습이 완료된 클러스터링 모델을 전달합니다.

- X (arr): 학습 데이터셋의 특징.

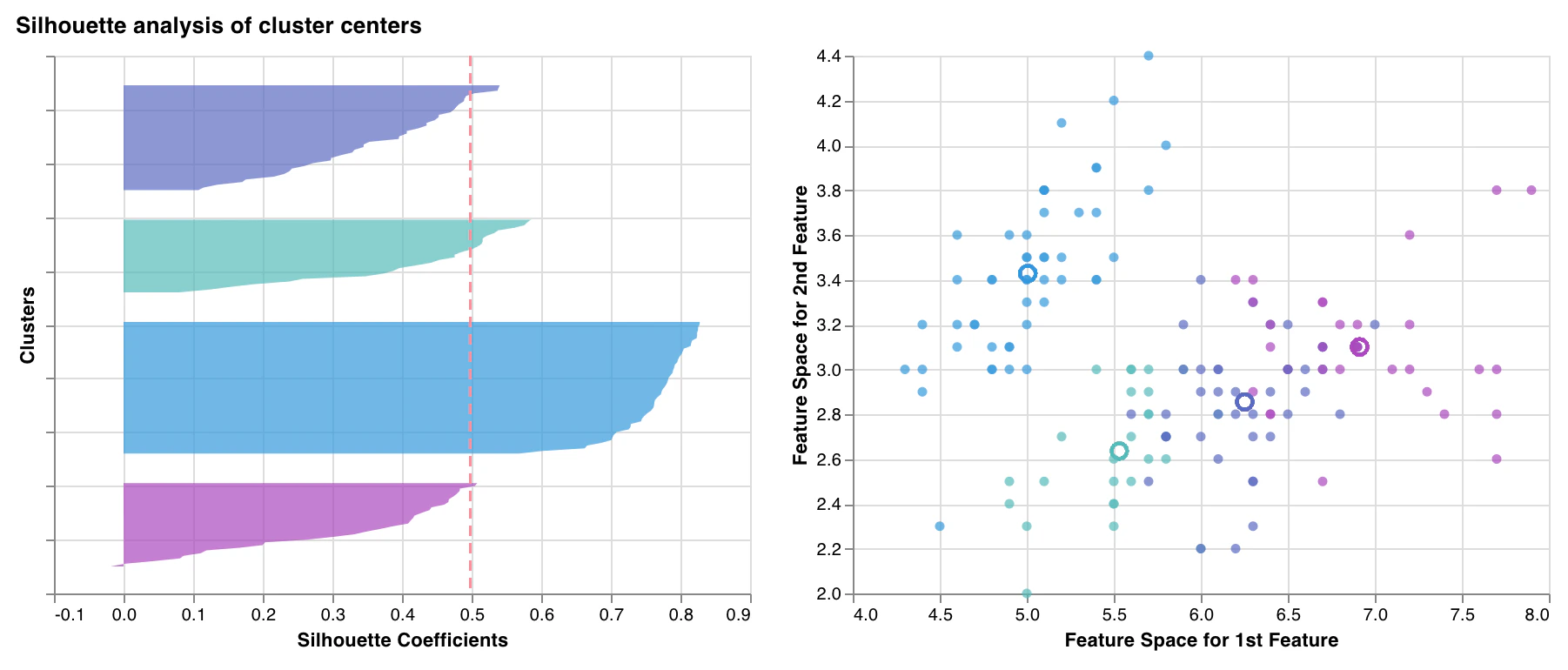

실루엣 플롯

wandb.sklearn.plot_silhouette(model, X_train, ['spam', 'not spam'])

- model (clusterer): 학습이 완료된 클러스터링 모델을 입력으로 받습니다.

- X (arr): 학습용 특성 배열입니다.

- cluster_labels (list): 클러스터 레이블의 이름입니다. 클러스터 인덱스를 해당 이름으로 바꿔 표시하여 플롯을 더 읽기 쉽게 만듭니다.

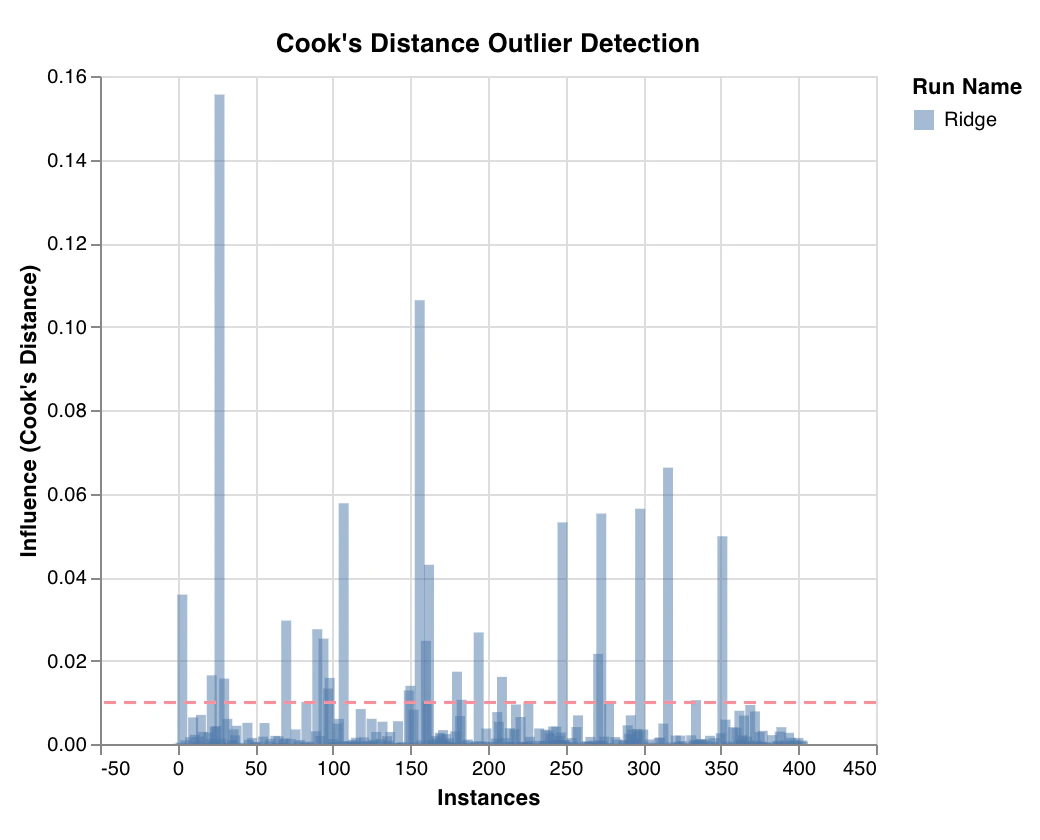

이상치 후보 플롯

wandb.sklearn.plot_outlier_candidates(model, X, y)

- model (regressor): 학습이 완료된 회귀 모델을 입력으로 받습니다.

- X (arr): 학습용 특성 배열입니다.

- y (arr): 학습용 레이블 배열입니다.

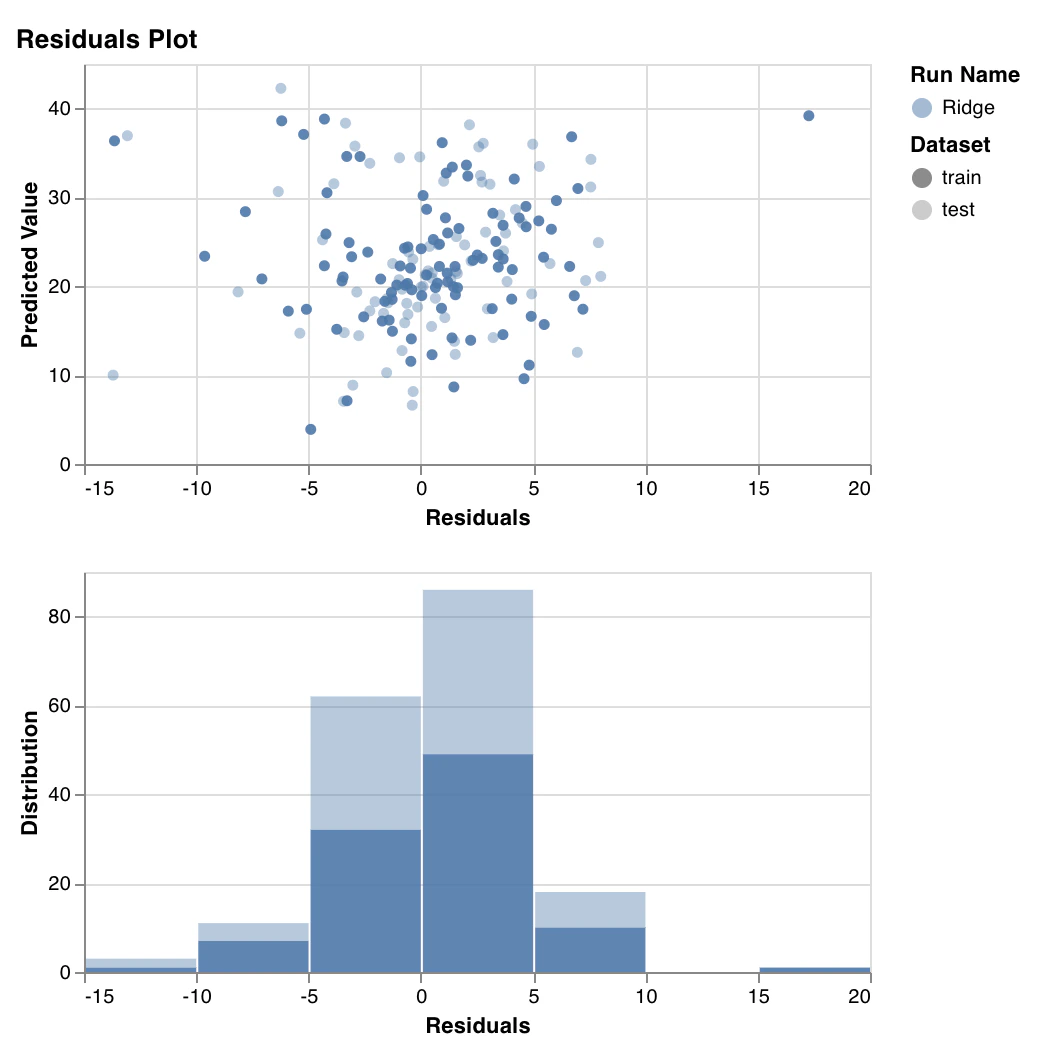

잔차 플롯

wandb.sklearn.plot_residuals(model, X, y)

- model (regressor): 학습이 완료된 회귀 모델을 입력으로 받습니다.

- X (arr): 학습 세트 특성.

- y (arr): 학습 세트 레이블. 질문이 있다면 Slack 커뮤니티에서 언제든지 문의해 주세요.

예시

- Colab에서 실행하기: 시작해 볼 수 있는 간단한 노트북입니다.