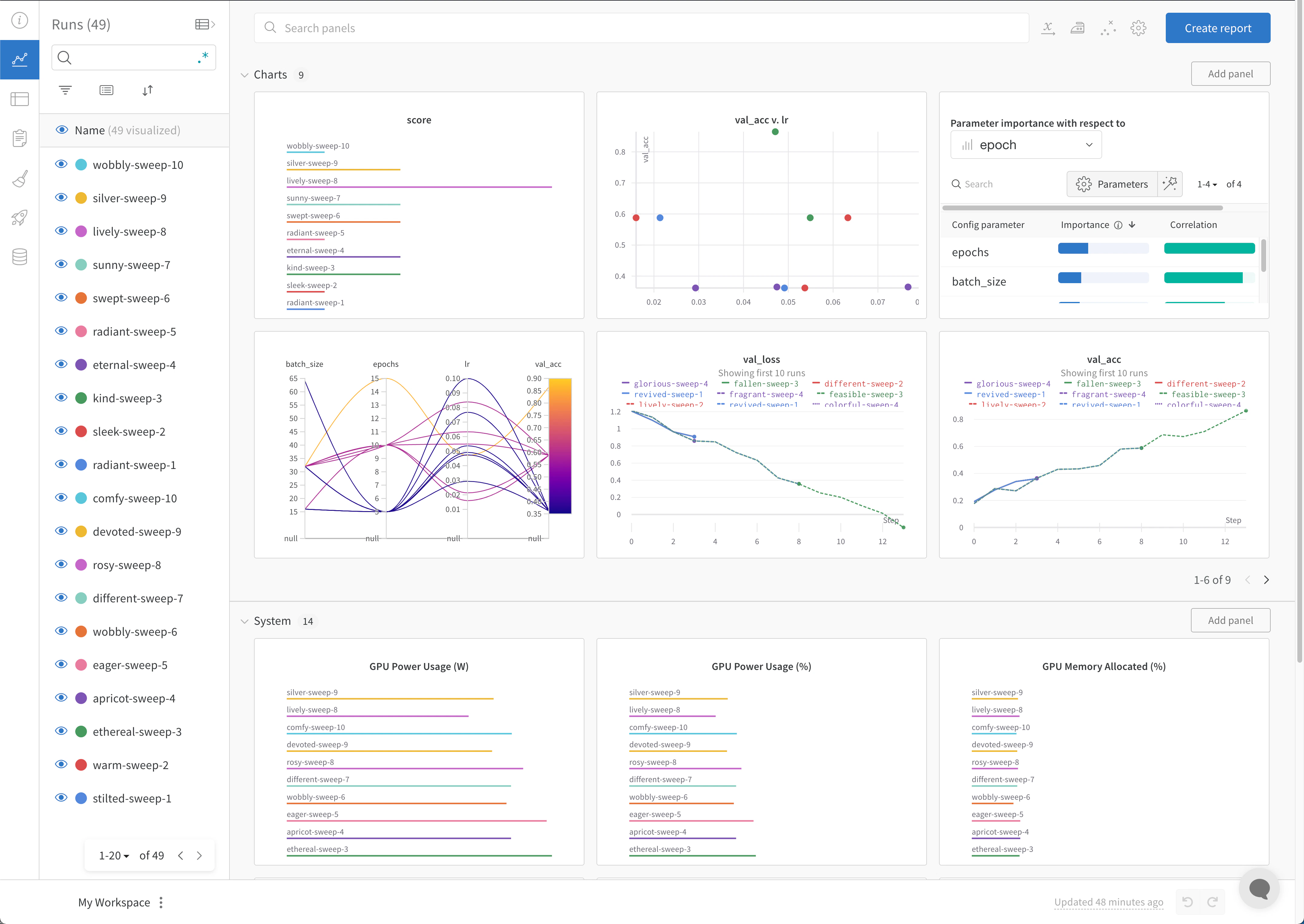

W&B Python SDK를 사용하여 머신 러닝 실험을 추적하세요. 그런 다음 대화형 대시보드에서 결과를 검토하거나, W&B Public API를 사용하여 프로그램적으로 액세스할 수 있도록 데이터를 Python으로 내보낼 수 있습니다. 이 가이드는 W&B 구성 요소를 사용하여 W&B Experiment를 생성하는 방법을 설명합니다.Documentation Index

Fetch the complete documentation index at: https://translations.mintlify.app/llms.txt

Use this file to discover all available pages before exploring further.

W&B 실험 생성 방법

W&B 실행 초기화하기

wandb.init()를 사용해 W&B 실행을 생성합니다.

다음 코드 스니펫은 “cat-classification”이라는 이름의 W&B 프로젝트에서 “My first experiment”라는 설명을 가진 실행을 생성해 이 실행을 쉽게 식별할 수 있도록 합니다. 또한 이 실행이 향후 논문 출판을 위한 베이스라인 실험임을 상기할 수 있도록 태그 “baseline”과 “paper1”를 추가합니다.

wandb.init()은 실행 객체를 반환합니다.

참고:

wandb.init()을 호출할 때 해당 프로젝트가 이미 존재하면, 실행은 기존 프로젝트에 추가됩니다. 예를 들어, 이미 “cat-classification”이라는 이름의 프로젝트가 있다면, 그 프로젝트는 그대로 유지되고 삭제되지 않습니다. 대신 새 실행이 해당 프로젝트에 추가됩니다.하이퍼파라미터 딕셔너리 저장하기

config에 저장한 모델 설정은 이후에 결과를 정리하고 조회하는 데 유용합니다.

훈련 루프 안에서 지표 기록하기

run.log()를 호출합니다.

W&B에 아티팩트 로깅하기

전체 코드 모아보기

다음 단계: 실험 시각화하기

모범 사례

- 실행을 종료하세요:

with문에서wandb.init()을 사용하면 코드가 완료되거나 예외가 발생할 때 실행이 자동으로 종료된 것으로 표시됩니다.-

Jupyter 노트북에서는 Run 객체를 직접 관리하는 것이 더 편리할 수 있습니다. 이 경우 Run 객체에서

finish()를 명시적으로 호출해 실행을 완료된 상태로 표시할 수 있습니다:

-

Jupyter 노트북에서는 Run 객체를 직접 관리하는 것이 더 편리할 수 있습니다. 이 경우 Run 객체에서

- Config: 하이퍼파라미터, 아키텍처, 데이터셋 및 모델 재현에 사용하고 싶은 모든 정보를 추적하세요. 이 값들은 열로 표시되며, Config 열을 사용해 앱에서 실행을 동적으로 그룹화하고, 정렬하고, 필터링할 수 있습니다.

- Project: 프로젝트는 함께 비교할 수 있는 일련의 실험입니다. 각 프로젝트에는 전용 대시보드 페이지가 있으며, 서로 다른 실행 그룹을 손쉽게 켜고 끄면서 다양한 모델 버전을 비교할 수 있습니다.

- Notes: 스크립트에서 바로 간단한 커밋 메시지를 설정하세요. 실행의 개요(Overview) 섹션에서 노트를 편집하고 확인할 수 있습니다(W&B App).

- Tags: 기준선 실행과 즐겨찾는 실행을 식별하세요. 태그를 사용해 실행을 필터링할 수 있습니다. 프로젝트 대시보드의 개요(Overview) 섹션에서 나중에 태그를 편집할 수도 있습니다(W&B App).

- 실험 비교를 위한 여러 실행 세트 생성: 실험을 비교할 때는 여러 실행 세트를 생성해 메트릭 비교를 쉽게 하세요. 동일한 차트 또는 차트 그룹에서 실행 세트를 켜거나 끌 수 있습니다.

wandb.init() API 문서를 참조하세요.